Experten für künstliche Intelligenz (KI) kommen in San Francisco zusammen, um darüber zu sprechen, wie man Modelle schützen kann, doch die Unsicherheit über die neue Trump-Regierung überschattet ihre Arbeit.

Regierungswissenschaftler und Experten für künstliche Intelligenz (KI) treffen sich diese Woche in den USA, während vor der zweiten Amtszeit des gewählten Präsidenten Donald Trump im Weißen Haus Fragen über die Zukunft der Branche auftauchen.

Beamte aus den USA und ihren Verbündeten hoffen, darüber sprechen zu können, wie eine Flut von KI-generierten Deepfakes, die Betrug, schädlichen Identitätswechsel und sexuellen Missbrauch befeuern, besser erkannt und bekämpft werden kann.

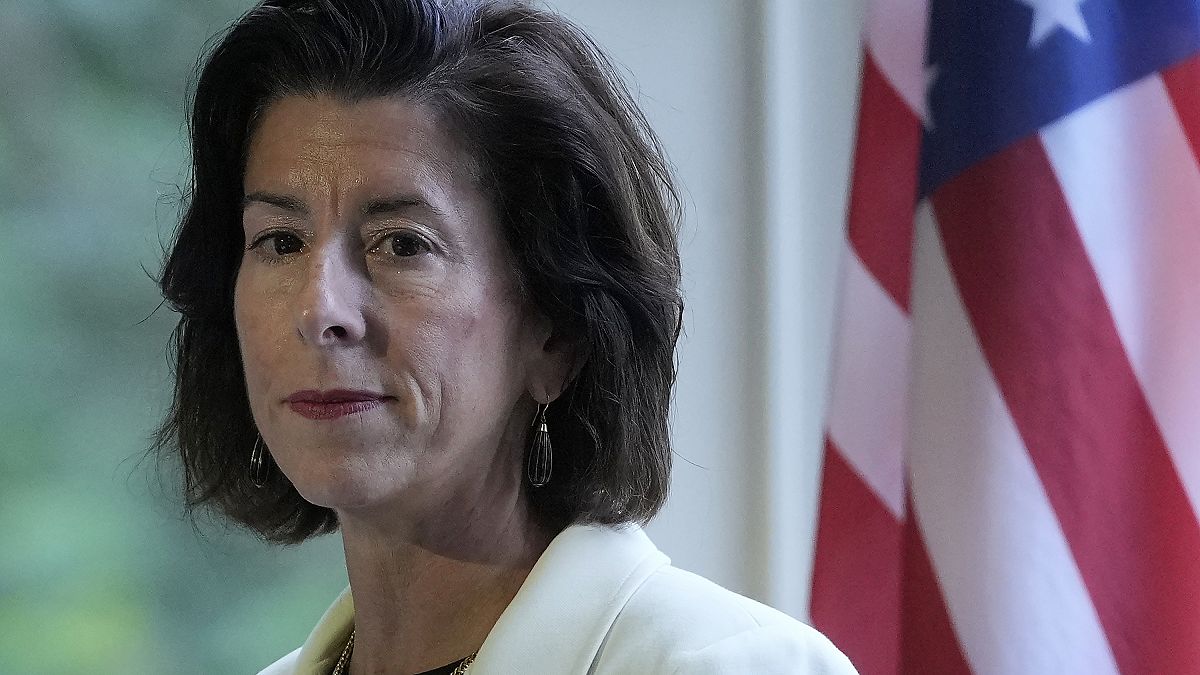

„Wir haben die Wahl“, sagte US-Handelsministerin Gina Raimondo am Mittwoch vor der Menge der Teilnehmer. „Wir sind diejenigen, die diese Technologie entwickeln. Sie sind diejenigen, die diese Technologie entwickeln. Wir können entscheiden, wie es aussieht.“

Das Treffen war das erste des Internationalen Netzwerks von KI-Sicherheitsinstitutewas während angekündigt wurde der KI-Gipfel in Seoul im Mai.

Die anhaltende Unsicherheit kommt aus dem Lager von Trump, der versprach, „Joe Bidens gefährliche Executive Order aufzuheben, die die KI-Innovation behindert und der Entwicklung dieser Technologie radikale linke Ideen aufzwingt“.

Biden unterzeichnete letztes Jahr eine umfassende KI-Durchführungsverordnung und gründete in diesem Jahr das neue KI-Sicherheitsinstitut am National Institute for Standards and Technology, das Teil des Handelsministeriums ist.

Aber Trump hat nicht deutlich gemacht, was ihm an der Anordnung nicht gefällt oder was er mit dem AI Safety Institute tun würde. Trumps Übergangsteam reagierte diese Woche nicht auf E-Mails mit der Bitte um Stellungnahme.

Trump verbrachte während seiner vier Jahre als Präsident nicht viel Zeit damit, über KI zu sprechen, obwohl er 2019 der erste war, der eine Durchführungsverordnung über KI unterzeichnete. Es wies die Bundesbehörden an, der Forschung und Entwicklung in diesem Bereich Vorrang einzuräumen.

„Sicherheit ist gut für Innovation“

Raimondo ging auf Bedenken hinsichtlich einer Verlangsamung von Innovationen ein und sagte, sie wolle klarstellen, dass das US AI Safety Institute keine Regulierungsbehörde sei und auch „nicht die Aufgabe habe, Innovationen zu unterdrücken“.

„Aber hier ist die Sache. Sicherheit ist gut für Innovation. Sicherheit schafft Vertrauen. Vertrauen beschleunigt die Akzeptanz. Die Einführung führt zu mehr Innovation“, sagte sie.

Einige Experten gehen davon aus, dass die technischen Arbeiten, die diese Woche in einem Club alter Militäroffiziere im Presidio-Nationalpark in San Francisco stattfinden, unabhängig davon fortgesetzt werden, wer die Leitung trägt.

„Es gibt keinen Grund zu der Annahme, dass wir bei der Arbeit des AI Safety Institute eine Kehrtwende machen werden“, sagte Heather West, Senior Fellow am Centre for European Policy Analysis. Hinter der Rhetorik, sagte sie, gebe es bereits Überschneidungen.

Raimondo und andere Beamte versuchten deutlich zu machen, dass KI-Sicherheit keine parteiische Angelegenheit ist.

„Übrigens ist dieser Raum größer als Politik. Politik ist in aller Munde. Ich möchte nicht über Politik reden. Es ist mir egal, welcher politischen Partei Sie angehören, das liegt weder im Interesse der Republikaner noch der Demokraten“, sagte sie.

„Offen gesagt hat niemand auf der Welt und in keiner politischen Partei ein Interesse daran, dass KI gefährlich ist oder dass KI in die Hände böswilliger nichtstaatlicher Akteure gerät, die Zerstörung anrichten und Chaos säen wollen.“